카카오가 사람처럼 보고, 듣고, 말하며 한국어와 한국 문화를 이해하는 고도화된 멀티모달(Multinodal) 인공지능(AI) 기술 연구 성과를 공개했다.

카카오는 12일 테크블로그를 통해 한국적 맥락 이해에 최적화된 통합 멀티모달 언어모델 '카나나(Kanana)-o'와 멀티모달 임베딩 모델 '카나나-v-임베딩(Kanana-v-embedding)'의 개발 과정과 성능을 발표했다.

멀티모달은 텍스트와 음성, 이미지 등 다양한 형태의 정보를 동시에 이해하고 처리·답변할 수 있는 능력이나 기술을 일컫는다. 카나나-o는 글로벌 모델과 비교해 한국어 맥락 이해에서 월등한 성능을 보유해 사람처럼 자연스럽고 풍부한 표현력을 갖췄다고 카카오는 밝혔다. 지난 5월 처음 공개한 뒤 지시 이행 능력을 개선했다.

카카오는 기존 멀티모달 모델들이 텍스트에는 강점이 있지만 음성으로 대화할 때 답변이 단순해지고 추론 능력이 떨어지는 점에 주목했다. 카나나-o는 지시 이행을 고도화해 사용자의 숨은 의도와 복잡한 요구사항도 파악할 수 있도록 개선했다.

아울러 단순 질의응답을 넘어 요약, 감정·의도 해석, 오류 수정, 형식 변환, 번역 등 다양한 과업을 수행할 수 있도록 성능을 끌어올렸다. 고품질 음성 데이터와 직접 선호 최적화(DPO) 기술을 적용해 억양과 감정, 호흡 등도 정교하게 학습시켰다.

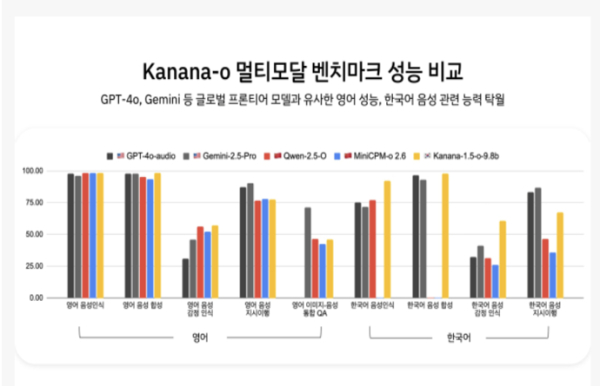

카카오는 성능 검증 평가 결과 카나나-o가 영어 음성 성능에서 GPT-4o와 유사한 수준을, 한국어 음성 인식·합성, 감정 인식 능력에서는 월등히 높은 수준을 기록했다고 소개했다.

함께 공개한 카나나-v-임베딩은 이미지 기반 검색의 핵심 기술로 텍스트와 이미지를 동시에 이해해 처리할 수 있는 한국형 멀티모달 모델이다. 실제 서비스 적용을 목표로 개발해 한국어와 한국 문화에 대한 이해도가 높다.

'경복궁' '붕어빵' 등 한국적인 이미지를 손쉽게 찾아준다. '한복 입고 찍은 단체 사진'처럼 복합 조건도 정확히 이해해 조건의 일부에 해당하는 사진을 걸러내는 변별력을 갖췄다.

현재 이 모델은 카카오 내부에서 광고 소재의 유사도를 분석·심사하는 시스템에 적용 하고 있다. 김병학 카나나 성과리더는 "카나나를 단순 정보 나열 수준을 넘어 사용자의 감정을 이해하며 친숙하고 자연스럽게 대화하는 AI가 될 수 있도록 하겠다"고 강조했다.